Alcuni anni fa, Google ha creato un nuovo tipo di chip per computer per potenziare i suoi giganteschi sistemi di intelligenza artificiale. Questi chip sono stati progettati per gestire i processi complessi che alcuni ritengono sarà una chiave per il futuro dell’industria informatica.

Lo scorso mese , il gigante di Internet ha detto che avrebbe permesso ad altre aziende di acquistare l’accesso a tali chip attraverso il proprio servizio di cloud computing. Google spera di costruire una nuova attività intorno ai chip, denominata unità di elaborazione del tensore o TPU

“Stiamo cercando di raggiungere quante più persone possibile il più velocemente possibile”, ha detto Zak Stone, che lavora a fianco del piccolo team di ingegneri di Google che progetta questi chip.

La mossa di Google evidenzia diversi cambiamenti radicali nel modo in cui la tecnologia moderna viene costruita e gestita. Google è all’avanguardia in un movimento per progettare chip specificamente per l’intelligenza artificiale, una spinta mondiale che include decine di start-up e nomi noti come Intel, Qualcomm e Nvidia .

E di questi tempi, aziende come Google, Amazon e Microsoft non sono solo grandi compagnie di internet. Sono grandi produttori di hardware.

Per ridurre i costi e migliorare l’efficienza dei data center multimiliardari che sostengono il suo impero online, Google progetta gran parte dell’hardware all’interno di queste enormi strutture, dai server dei computer alle apparecchiature di rete che collegano queste macchine . Altri giganti di internet fanno lo stesso .

Oltre ai suoi chip TPU, che si trovano all’interno dei suoi data center, l’azienda ha progettato un chip AI per i suoi smartphone .

In questo momento, il nuovo servizio di Google è incentrato su un modo per insegnare ai computer a riconoscere gli oggetti, chiamati tecnologie di visione artificiale. Ma col passare del tempo, i nuovi chip aiuteranno anche le aziende a costruire una gamma più ampia di servizi, ha affermato Stone.

In questo momento, il nuovo servizio di Google è incentrato su un modo per insegnare ai computer a riconoscere gli oggetti, chiamati tecnologie di visione artificiale. Ma col passare del tempo, i nuovi chip aiuteranno anche le aziende a costruire una gamma più ampia di servizi, ha affermato Stone.

Alla fine dell’anno scorso, sperando di accelerare il lavoro sulle auto senza conducente, Lyft ha iniziato a testare i nuovi chip di Google.

Utilizzando i chip, Lyft voleva accelerare lo sviluppo di sistemi che permettessero alle auto senza conducente di identificare, ad esempio, segnali stradali o pedoni. “Addestrare” questi sistemi può richiedere giorni, ma con i nuovi chip, la speranza è che questo sarà ridotto a ore.

“C’è un enorme potenziale qui”, ha dichiarato Anantha Kancherla, che supervisiona il software per il progetto di auto senza conducente Lyft.

I chip TPU hanno contribuito ad accelerare lo sviluppo di tutto, dall’assistente Google, al servizio che riconosce i comandi vocali sui telefoni Android, a Google Translate, l’app Internet che traduce una lingua in un’altra.

Stanno anche riducendo la dipendenza di Google da produttori di chip come Nvidia e Intel. In una mossa simile, ha progettato i propri server e hardware di rete, riducendo la dipendenza da produttori di hardware come Dell, HP e Cisco.

Ciò mantiene bassi i costi, il che è essenziale quando si esegue una grande operazione online, ha detto Casey Bisson, che aiuta a supervisionare un servizio di cloud computing chiamato Joyent, che è di proprietà di Samsung. A volte, l’unico modo per creare un servizio efficiente è costruire il tuo hardware.

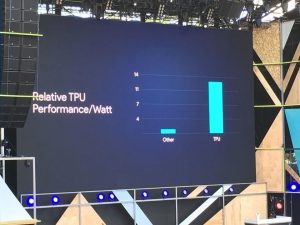

“Si tratta di comprimere più potenza di calcolo possibile all’interno di una piccola area, all’interno di un budget di calore, all’interno di un budget energetico”, ha affermato Bisson.

Una nuova ondata di intelligenza artificiale, inclusi servizi come Assistente Google, è guidata da ” reti neurali “, che sono algoritmi complessi in grado di apprendere le attività da soli analizzando una grande quantità di dati. Analizzando un database di vecchie chiamate telefoniche di assistenza clienti, ad esempio, una rete neurale può imparare a riconoscere i comandi pronunciati in uno smartphone. Ma questo richiede una potenza di calcolo seria.

In genere, gli ingegneri addestrano questi algoritmi utilizzando unità di elaborazione grafica o GPU, che sono chip che sono stati originariamente progettati per il rendering di immagini per giochi e altri software grafici pesanti. La maggior parte di questi chip è fornita da Nvidia.

Nel progettare i propri chip di intelligenza artificiale, Google stava cercando di superare ciò che era possibile con questi chip orientati alla grafica, velocizzare il proprio lavoro di intelligenza artificiale e attirare più aziende sui propri servizi cloud.

Allo stesso tempo, Google ha acquisito una certa indipendenza da Nvidia e la capacità di negoziare prezzi più bassi con i suoi fornitori di chip.

“Google è diventato così grande, ha senso investire in chip”, ha detto Fred Weber, che ha trascorso un decennio in qualità di chief technology officer presso il produttore di chip AMD. “Questo dà loro leva. Possono tagliare l’intermediario. ”

Ciò non significa che Google smetterà di acquistare chip da Nvidia e altri produttori di chip. Ma sta alterando il mercato. “Chi sta comprando e chi sta vendendo è cambiato”, ha detto Weber.

Nel corso degli anni, Google ha persino flirtato con la possibilità di progettare la propria versione dei chip acquistati da Intel.

Il signor Weber e altri addetti ai lavori si chiedono se Google lo farebbe mai, solo perché una CPU è così complessa e sarebbe molto più difficile progettare e mantenere uno di questi chip. Ma in un evento privato a San Francisco lo scorso autunno, David Patterson, un professore di informatica all’Università della California, Berkeley, che ora lavora su tecnologie di chip in Google, è stato chiesto se la società sarebbe andata così lontano. “Non è scienza missilistica”, ha risposto……