La provincia canadese del Manitoba ha tracciato un nuovo confine nella governance tecnologica mondiale, annunciando una politica pionieristica che mira a limitare l’accesso dei giovani non solo ai social media, ma anche ai chatbot basati sull’intelligenza artificiale. L’annuncio, formalizzato dal Premier Wab Kinew, posiziona la provincia all’avanguardia di un movimento normativo che sta guadagnando trazione a livello globale, spostando però il focus dalla semplice moderazione dei contenuti testuali a una restrizione strutturale sull’uso di agenti conversazionali autonomi da parte degli adolescenti. Questa decisione si fonda sulla premessa che l’interazione con l’intelligenza artificiale, se non regolamentata, possa interferire drasticamente con i processi cognitivi e lo sviluppo psicologico dei minori.

Il fulcro dell’argomentazione del governo del Manitoba risiede nella natura economica e algoritmica di queste piattaforme. Il Premier Kinew ha esplicitamente accusato i chatbot e i social media di operare attraverso un meccanismo di “furto dell’attenzione”, dove il design del software non è orientato esclusivamente all’utilità dell’utente, ma alla massimizzazione del tempo di permanenza per scopi di profitto. Tecnicamente, l’IA generativa utilizza cicli di feedback progettati per essere altamente coinvolgenti, il che, secondo le autorità provinciali, potrebbe esacerbare problemi legati alla salute mentale, riducendo la capacità di concentrazione e alterando la percezione della realtà sociale nei soggetti in età evolutiva.

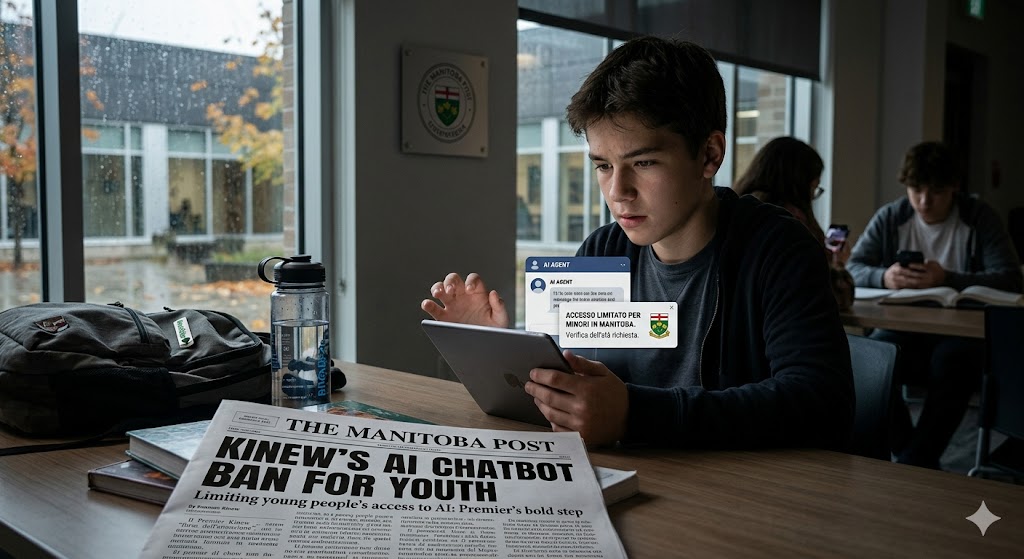

Sebbene i dettagli tecnici relativi alle soglie di età e ai protocolli di verifica dell’identità debbano ancora essere definiti, l’iniziativa del Manitoba si inserisce in un quadro di crescenti tensioni tra governi e aziende tecnologiche. Mentre paesi come l’Australia hanno già legiferato per vietare i social media ai minori di 16 anni, l’inclusione esplicita dei chatbot rappresenta un unicum normativo. Il governo federale canadese sta osservando con attenzione questa sperimentazione locale, che potrebbe fungere da modello per una legislazione nazionale più ampia, mirata a mitigare i rischi di cyberbullismo e l’esposizione a dinamiche di manipolazione algoritmica.

Un fattore determinante che ha accelerato questa presa di posizione sembra essere legato a gravi problemi di sicurezza pubblica e trasparenza aziendale. Il riferimento critico riguarda una sparatoria avvenuta nella Columbia Britannica all’inizio di quest’anno, un evento che ha sollevato interrogativi sulla velocità con cui le aziende di IA condividono i dati con le forze dell’ordine. Il coinvolgimento indiretto di piattaforme di chatbot in contesti di radicalizzazione o pianificazione di atti criminali ha spinto i legislatori a riconsiderare l’IA non solo come uno strumento di produttività, ma come un’entità che richiede una supervisione rigorosa, specialmente quando interagisce con fasce di popolazione vulnerabili.

In definitiva, la mossa del Manitoba segna il passaggio da una regolamentazione “post-hoc”, basata sulla rimozione di contenuti dannosi, a una prevenzione “ex-ante”, che limita l’accesso alla tecnologia stessa. La sfida futura per la provincia risiederà nell’implementazione tecnica di questi divieti, che richiederanno una collaborazione complessa con i fornitori di servizi per creare barriere digitali efficaci senza compromettere la privacy generale degli utenti. Questa politica stabilisce un precedente significativo che costringe l’industria dell’intelligenza artificiale a confrontarsi con una responsabilità etica e legale che va oltre la semplice fornitura di modelli linguistici, ponendo la protezione dell’infanzia al centro dell’agenda politica digitale.