L’ecosistema Apple si prepara a vivere uno dei momenti di svolta più significativi della sua storia recente. Con l’arrivo di iOS 26.4, previsto per la primavera del 2026, Siri smetterà di essere un semplice esecutore di comandi vocali per trasformarsi in un vero e proprio assistente digitale intelligente. Questo aggiornamento non è un semplice ritocco estetico, ma una vera e propria rifondazione strutturale che vede l’integrazione di modelli linguistici di grandi dimensioni (LLM) e una collaborazione strategica con Google per l’adozione della tecnologia Gemini. L’obiettivo è colmare il divario con i chatbot più avanzati e offrire un’esperienza utente che sia finalmente proattiva, contestuale e profondamente personalizzata.

Il cuore pulsante di questa rivoluzione è il passaggio a una nuova architettura basata sull’intelligenza artificiale generativa. Per anni, Siri ha operato entro i limiti di uno schema rigido basato sul riconoscimento di parole chiave, ma con iOS 26.4 il sistema sarà in grado di comprendere il linguaggio naturale in modo molto più fluido. La scelta di Apple di affiancare ai propri modelli proprietari la potenza di Google Gemini indica la volontà di accelerare i tempi, offrendo agli utenti iPhone capacità di ragionamento e di assistenza che fino a poco tempo fa sembravano destinate esclusivamente ai computer desktop o ai servizi cloud più complessi.

Una delle innovazioni più attese riguarda la cosiddetta “consapevolezza dello schermo”. Grazie a questa funzione, Siri sarà in grado di “vedere” e interpretare ciò che l’utente sta visualizzando in un determinato momento. Se, ad esempio, stiamo leggendo un’email riguardante la prenotazione di un volo o un messaggio con un indirizzo, potremo chiedere a Siri di aggiungere quelle informazioni al calendario o alle note senza dover specificare ogni dettaglio: l’assistente saprà già di cosa stiamo parlando guardando il contesto attivo sul display. Questo riduce drasticamente i passaggi necessari per completare operazioni quotidiane, rendendo l’interazione con lo smartphone molto più simile a una conversazione con un collaboratore umano.

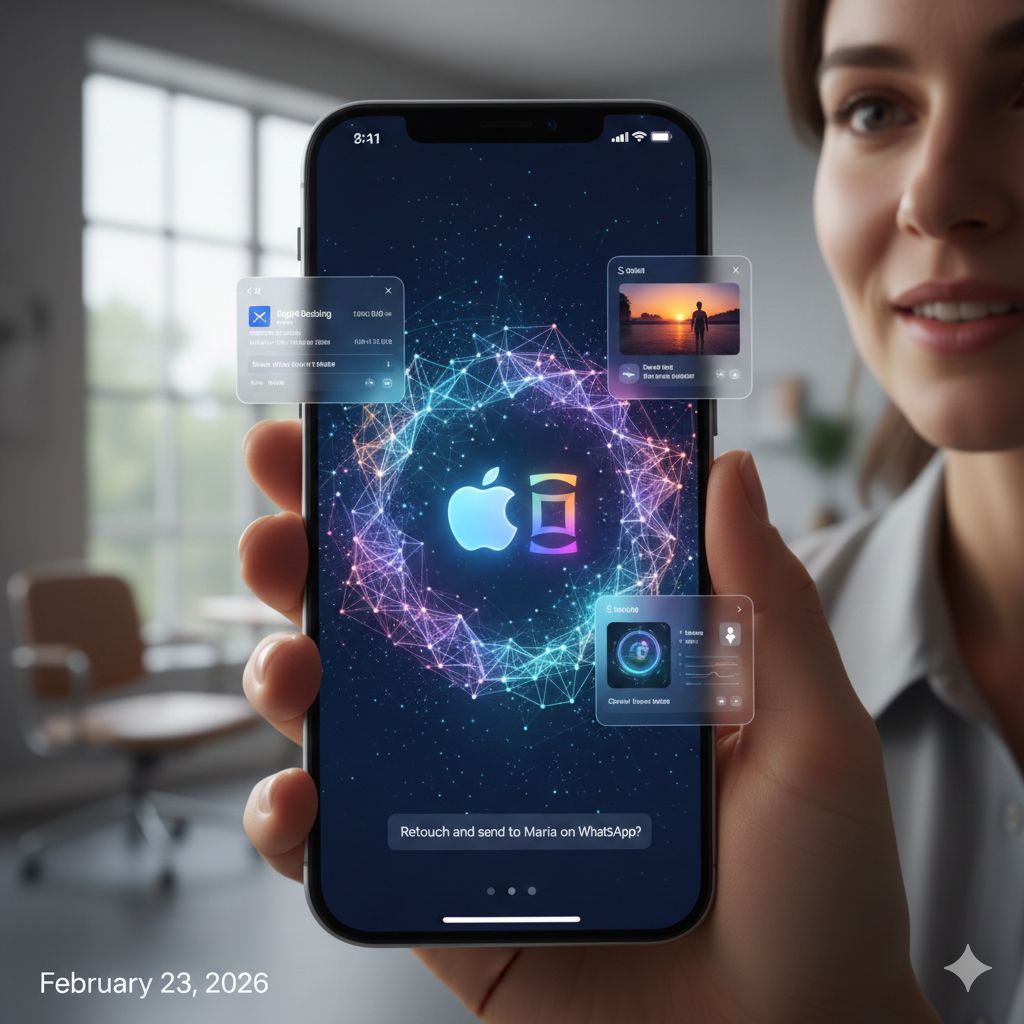

Oltre alla comprensione visiva, il nuovo aggiornamento punta tutto sul contesto personale. Siri attingerà in modo sicuro e privato alle abitudini dell’utente, alla sua cronologia di messaggi e ai suoi impegni, non solo per rispondere a domande ma per anticipare i bisogni. L’assistente diventerà capace di eseguire azioni complesse che attraversano diverse applicazioni: con un singolo comando vocale, sarà possibile chiedere di ritoccare una foto e inviarla a un contatto specifico via WhatsApp, lasciando che Siri gestisca autonomamente l’apertura delle app e i passaggi intermedi. È un’evoluzione che trasforma l’iPhone in una piattaforma operativa dove l’utente si concentra sul risultato finale, mentre l’intelligenza artificiale si occupa dell’esecuzione tecnica.

Il calendario dei rilasci segue il classico schema di Apple, ma con una tabella di marcia serrata. Le indiscrezioni più recenti indicano che la prima versione beta per gli sviluppatori potrebbe apparire già nella settimana del 23 febbraio 2026, seguita a stretto giro da una beta pubblica tra la fine di febbraio e l’inizio di marzo. Se i test procederanno senza intoppi, il rilascio ufficiale per tutti gli utenti è previsto tra la fine di marzo e il mese di aprile. Questo aggiornamento non porterà solo la nuova Siri; sono attesi anche miglioramenti tangibili in altre aree del sistema operativo, come un’applicazione Salute completamente ridisegnata per facilitare il monitoraggio dei parametri vitali e l’introduzione di un nuovo pacchetto di emoji, mantenendo viva la tradizione di arricchire l’interfaccia con elementi visivi sempre nuovi.