Informazioni imperfette, AI sovrumana imperfetta

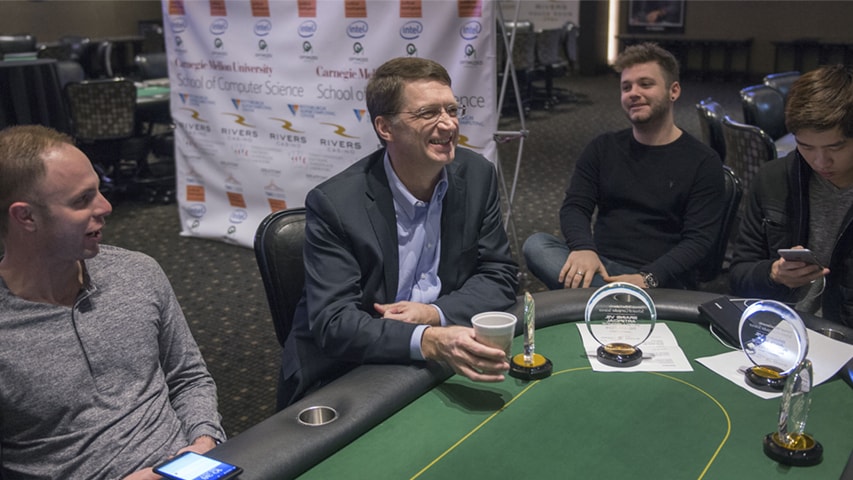

L’intelligenza artificiale dovrebbe essere autorizzata a fare le nostre scommesse? Facebook con i ricercatori di Carnegie Mellon AI ha appena creato un’intelligenza artificiale che può battere le persone nel poker. Questo è un risultato monumentale. Nel poker non esiste una risposta ottimale, nessuna serie di mosse vincenti da trovare. Invece, c’è la migliore scommessa da prendere per massimizzare la ricompensa e minimizzare il rischio. Ma possiamo applicare agenti addestrati per avere successo in scenari con informazioni imperfette, in modo responsabile? In che modo questi tipi di intelligenza umana sovrumana possono fare scommesse sbagliate e come possiamo progettare sistemi intorno a loro per il bene sociale?

un’occhiata a un esperimento mentale. La diagnosi e il trattamento medico sono una delle aree più sviluppate e prolifiche della ricerca sull’apprendimento automatico. La diagnosi è, per la maggior parte, un problema di classificazione. Si dispone di una grande quantità di dati di input dal paziente, come dati di sintomi, dati ambientali, ecc. Gli algoritmi di machine learning vengono applicati per trovare modelli tra le enormi quantità di dati per diagnosticare il paziente. Spesso gli algoritmi trovano schemi così intricati che i professionisti non sempre ne hanno un senso. La diagnosi è una classica applicazione di apprendimento automatico che viene fornita con le sue domande etiche. Per motivi di esperimento, supponiamo che il medico sia molto acuto o che un algoritmo ML dia la diagnosi corretta.

Raccomandare il trattamento, tuttavia, non è un problema di classificazione standard. È un gioco di informazioni imperfette. Devi scommettere sulla migliore procedura data la persona e la diagnosi. Il compito dell’algoritmo è quello di esaminare le varie possibilità di successo del trattamento, la diagnosi e la persona e raccomandare il miglior corso di trattamento possibile per salvargli la vita. Potrebbero non avere il tempo di prendere più trattamenti, quindi ogni raccomandazione deve essere di alta qualità. Questo problema è dove la ricerca di Facebook e CMU potrebbe essere potenzialmente applicata. Dopotutto, se a tutti fosse stata diagnosticata correttamente e ricevesse il miglior trattamento possibile, non sarebbe un mondo che merita di essere costruito?

Purtroppo, potrebbe non essere possibile. Se facciamo un agente di AI per raccomandare il trattamento, potremmo trovare gli stessi punti ciechi dei medici. Un agente che sta raccomandando trattamenti dovrebbe probabilmente esaminare le percentuali di successo delle varie terapie come parte delle molte caratteristiche dei dati da analizzare. Le percentuali di successo possono essere p-hackerate o manipolate statisticamente in modo disastroso per essere più alte di quanto non siano. Ad esempio, Lipitor, un farmaco che è stato proclamato con un tasso di successo del 36% mentre in realtà, con un tasso di successo dell’1%. Un agente AI che raccomanda trattamenti e osserva metriche come il tasso di successo potrebbe fare la scommessa sbagliata.

I medici possono anche cadere preda di percentuali di successo errate. Questa debolezza è il problema. I medici e l’IA sovrumana hanno lo stesso difetto: dati corrotti o distorti. Ma i medici possono fornire ragioni per la loro diagnosi. Guarda il più difficile possibile, ma non è realistico trovare il modello esatto tra 50.000 matrici tutte moltiplicate insieme in diversi modi sequenziali e identificare correttamente il motivo. Forse potresti creare un’intelligenza artificiale per comprendere e tradurre le intuizioni dell’intelligenza artificiale nella comprensione umana, ma ti imbatteresti di nuovo nello stesso problema.

Pur essendo in grado di sovraperformare gli umani in aree con informazioni imperfette, dipendiamo comunque da dati precisi e imparziali sui problemi da affrontare. Il gioco d’azzardo su ciò che è possibile è una domanda cruciale per il futuro dell’IA.