L’intelligenza artificiale deve essere una delle tecnologie più impattanti che il mondo abbia visto negli ultimi anni. Non è più solo limitato ai pittoreschi laboratori di ricerca e sviluppo delle accademie e delle istituzioni più grandi, ma è penetrato con successo nel funzionamento normale e quotidiano della società.

Come ogni altra tecnologia, anche l’intelligenza artificiale presenta una serie di sfide. Tuttavia, la posta in gioco è leggermente più alta, considerando l’impatto che può avere la tecnologia IA divenuta canaglia. Di seguito elenchiamo alcuni dei momenti più controversi dell’industria dell’IA nel 2020. Se non altro, questo può essere considerato un allarme cautelativo per il futuro.

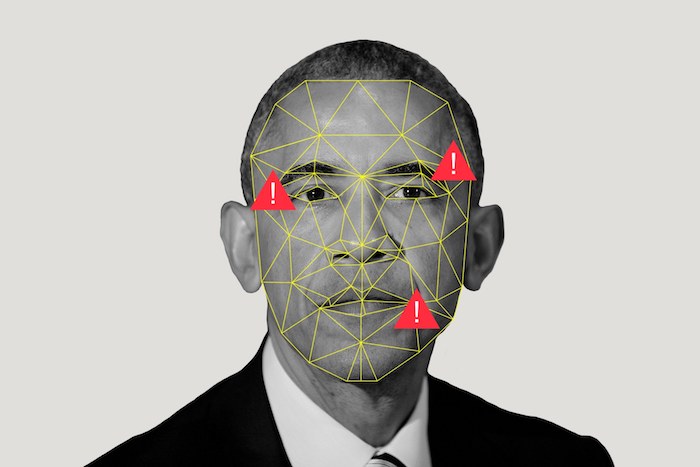

Clearview AI e tecnologia di riconoscimento facciale

‘The Secretive azienda che potrebbe finire sulla As We Know It’, questo era il titolo di The New York Times un articolo pubblicato nel gennaio 2020. In questo articolo era di circa Clearview AI , una startup fondata da imprenditore australiano Hoan Ton-That. Un software di riconoscimento facciale nella sua forma più primitiva è già dibattuto, ma c’è un ulteriore problema con Clearview AI a causa del modo senza scrupoli in cui opera. Secondo quanto riferito, ha raccolto e archiviato miliardi di immagini personali di persone in tutto il mondo dal web e dagli account dei social media nel proprio database senza alcun sistema di autorizzazione adeguato. Queste immagini nel database sono state quindi confrontate con foto di persone sconosciute utilizzando la tecnologia di riconoscimento facciale.

I dati e la tecnologia di Clearview erano accessibili da almeno 26 paesi e dalle loro forze dell’ordine, anche se la società affermava rigorosamente di aver fornito accesso solo alle autorità interessate di Stati Uniti e Canada. Anche in India, è stato riferito che anche i servizi di polizia del Gujarat hanno utilizzato la tecnologia di riconoscimento facciale di Clearview. Inoltre, nonostante la smentita ufficiale della società stessa, un rapporto “trapelato” ha rivelato che oltre a 2.200 organizzazioni di polizia nel mondo, anche molte organizzazioni private avevano adottato questa tecnologia.

Man mano che la controversia prendeva piede, Facebook, Twitter, Google e YouTube hanno inviato lettere di cessazione e desistenza alla società dopo che questi giganti della tecnologia hanno rilasciato che stava raschiando immagini da queste piattaforme. Attualmente, diversi paesi, incluso il Canada, hanno completamente rimosso questa tecnologia o stanno indagando attivamente sulla questione.

GPT-3

Nel giugno di quest’anno, i ricercatori di OpenAI hanno rilasciato GPT-3, un modello linguistico all’avanguardia. Mentre il suo predecessore GPT-2 aveva 1,5 miliardi di parametri ed era considerato il modello più grande al momento del suo rilascio, GPT-3 lo ha superato di miglia con 175 miliardi di parametri. Per avere una prospettiva di quanto sia grande il modello, sarebbe utile considerare che è dieci volte più grande di Turing NLG che lo segue.

Al momento della sua introduzione, diverse sezioni l’hanno definita la rivoluzione del concetto di macchine che scrivono codici come gli esseri umani e che hanno fatto un ulteriore passo avanti scrivendo blog, storie, siti Web e app. Uno dei migliori esempi sarebbe il caso di uno studente universitario che ha creato un intero blog utilizzando GPT-3. Un altro caso riguardava un bot basato su GPT-3 che è stato sorpreso a interagire con le persone nella sezione dei commenti dei thread di Reddit . Il Guardian ha anche scritto un intero articolo utilizzando questo modello di linguaggio .

GPT-3, con la sua gamma di capacità, non è stato immune alle critiche. Con la sua capacità di produrre testi molto simili all’uomo, sono state sollevate ovvie preoccupazioni contro i suoi abusi come spam e phishing, scrittura fraudolenta di saggi accademici, pretesti di ingegneria sociale e abuso di processi legali, tra gli altri.

Le critiche hanno guadagnato ulteriore terreno quando OpenAI ha deciso di concedere il suo accesso esclusivo a Microsoft . Questo passaggio è stato severamente criticato anche da grandi parrucche come Elon Musk, uno dei fondatori di OpenAI stesso.

Ci sono altre carenze di GPT-3 come software, che includono: bias nel testo generato, scarsa comprensione delle parole reali per produrre pezzi più lunghi e comprensibili e scarsa generalizzazione. Di recente, Yann LeCun, VP e Chief AI Scientist di Facebook , ha distrutto l’enorme modello linguistico di OpenAI. Ha richiamato l’ attenzione sulle aspettative irrealistiche della gente da questo software, che secondo lui “è divertente e forse leggermente utile come strumento creativo”.

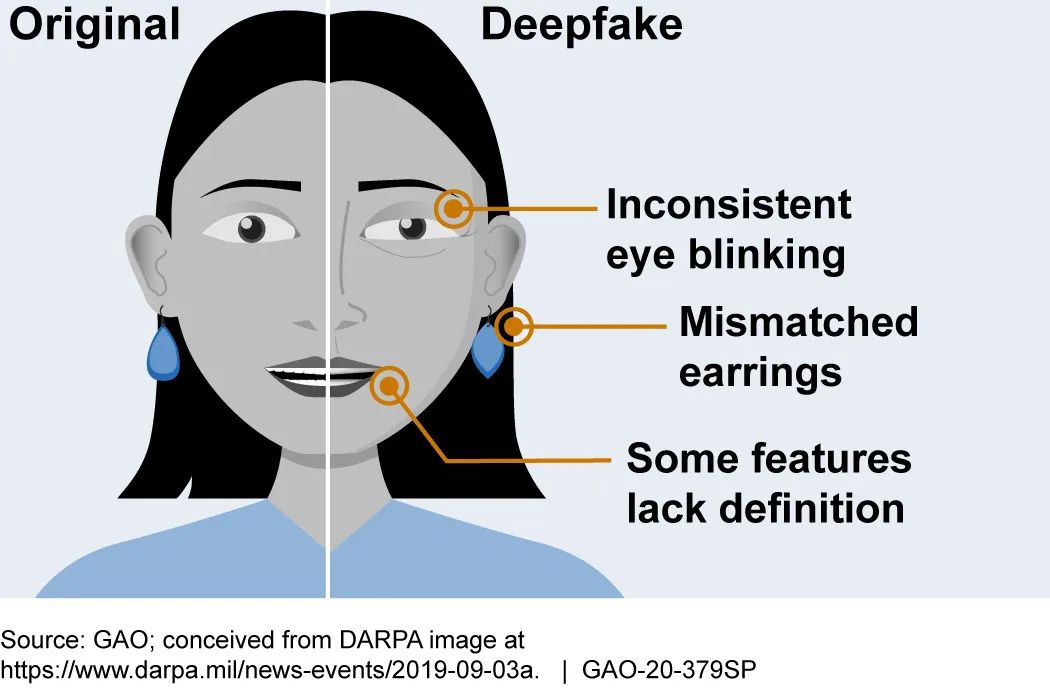

Video deepfake

Deepfake, di per sé, è stata una tecnologia piuttosto controversa sin dall’inizio. È stata una preoccupazione mondiale per le autorità riguardo al suo uso improprio. Mentre in precedenza, i deepfake erano per lo più limitati alla realizzazione di video divertenti e divertenti, la crescente accessibilità di strumenti facili da usare e il progresso nei GAN hanno reso più facile per menti note la generazione di video e immagini generati da AI dall’aspetto quasi autentico.

Ci sono stati diversi casi in cui i volti delle celebrità famose, in particolare delle donne, sono stati trasformati in video altamente discutibili. A parte questo, si temeva che i deepfake influenzassero maliziosamente le elezioni in un anno in cui i principali paesi e stati si stavano recando alle urne. Ad esempio, l’India ha visto il suo primo utilizzo di deepfake per una campagna elettorale quando un leader del BJP ha pubblicato un video della campagna, dove inizialmente parlava in hindi, tuttavia, utilizzando la tecnica del deepfake, lo stesso video è stato rilasciato anche in alcune altre lingue. Sebbene questo particolare caso d’uso sembrasse piuttosto innocuo, i critici si affrettarono a lanciare l’allarme per la possibile creazione di un precedente pericoloso.

Sistema di classificazione basato su AI nel Regno Unito

I blocchi in più paesi hanno significato che il normale funzionamento della vita e della società ha subito un duro colpo. Ogni aspetto, dalla sanità, alla governance, all’istruzione e alla mescolanza intersociale, ha visto una serie completa di sfide. A proposito di istruzione, molte scuole e college sono stati chiusi a tempo indeterminato per paura del virus. Gli esami sono stati posticipati o annullati insieme, tenuto conto della situazione.

Tuttavia, ad agosto, il dipartimento di regolamentazione degli esami del Regno Unito chiamato Office of Qualifications and Examinations Regulation (Ofqual) ha deciso di adottare un sistema di valutazione basato sull’intelligenza artificiale per misurare le prestazioni degli studenti dall’esame di livello A che decide che lo studente deve andare a quale università aveva da annullare. Genitori e figli hanno protestato con forza contro questo sistema poiché hanno affermato che gli algoritmi erano fortemente prevenuti contro gli studenti più poveri. Gli esperti hanno anche definito questo sistema “non etico e dannoso per l’istruzione”. Tenendo presenti le dure e implacabili critiche e proteste contro questa classificazione basata sull’intelligenza artificiale, il governo del Regno Unito ha dovuto finalmente abbandonarla e ha deciso che avrebbe invece utilizzato la discrezione degli insegnanti e altri parametri per assegnare i voti agli studenti.

Qualità “terribile” delle recensioni presso NeurIPS

Questa non è particolarmente una controversia relativa all’IA, ma getta una luce piuttosto scarsa sulla qualità e sulle pratiche della ricerca. Si occupa della conferenza annuale sui sistemi di elaborazione delle informazioni neurali, NeurIPS 2020, tenutasi praticamente quest’anno. Questo famoso evento di machine learning ha visto il 38% in più di invii rispetto allo scorso anno. Il periodo di revisione della presentazione dei documenti è iniziato a luglio e, ad agosto, la conferenza ha inviato le revisioni dei documenti.

Queste recensioni sono state sottoposte allo scanner per essere di qualità “terribile” in quanto non chiare o incomplete, in alcuni casi, entrambe le cose. I critici hanno chiesto una maggiore responsabilità per i revisori poveri , e alcuni sono persino andati all’estensione della richiesta di scioglimento di tali persone con un comprovato record negativo.