Queste facce mostrano fino a che punto la generazione di immagini AI è avanzata in soli quattro anni

Gli sviluppi dell’intelligenza artificiale si muovono ad un ritmo sorprendente, tanto che spesso è difficile tenere traccia . Ma un’area in cui il progresso è semplice quanto il naso sul tuo volto generato dall’IA è l’uso di reti neurali per creare immagini false. In breve: stiamo diventando molto bravi.

Nell’immagine qui sopra puoi vedere quali sono i quattro anni di progresso nella generazione di immagini AI. I grezzi volti in bianco e nero sulla sinistra sono del 2014 , pubblicati come parte di un documento di riferimento che ha introdotto lo strumento di intelligenza artificiale noto come la rete generativa avversaria (GAN). Le facce di colore sulla destra provengono da un articolo pubblicato all’inizio di questo mese , che utilizza lo stesso metodo di base ma è chiaramente un mondo a parte in termini di qualità dell’immagine.

Questi volti realistici sono opera di ricercatori di Nvidia. Nel loro articolo, condiviso pubblicamente la settimana scorsa, descrivono la modifica dell’architettura GAN di base per creare queste immagini. Dai un’occhiata alle immagini qui sotto. Se non sapessi che erano falsi, potresti dire la differenza?

Alcuni dei volti generati da IA di Nvidia . Immagine: Karras, Laine, Aila

Ciò che è particolarmente interessante è che queste facce finte possono anche essere facilmente personalizzate. Gli ingegneri di Nvidia hanno incorporato un metodo noto come trasferimento di stile nel loro lavoro, in cui le caratteristiche di un’immagine si fondono con un’altra. Potresti riconoscere il termine da vari filtri di immagine che sono popolari su app come Prisma e Facebook negli ultimi anni, che possono far sembrare i tuoi selfie un quadro impressionista o un’opera d’arte cubista.

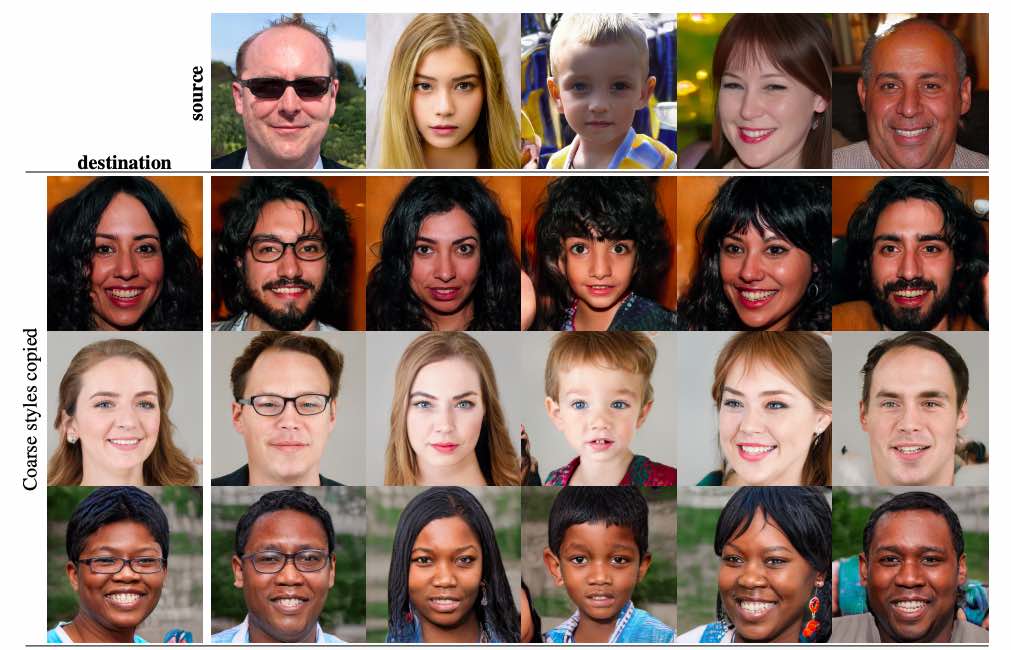

L’applicazione del trasferimento di stile alla generazione di volti ha permesso ai ricercatori di Nvidia di personalizzare i volti in modo impressionante. Nella griglia qui sotto, puoi vederlo in azione. Un’immagine sorgente di una persona reale (la riga superiore) ha le caratteristiche facciali di un’altra persona (colonna di destra) imposto su di essa. Tratti come la pelle e il colore dei capelli si fondono insieme, creando ciò che sembra essere una persona completamente nuova nel processo.

Il trasferimento di stile ti consente di fondere le caratteristiche del viso di persone diverse. Immagine: Karras, Laine, Aila

Naturalmente, la capacità di creare facce AI realistiche solleva domande inquietanti. (Non da ultimo, per quanto tempo fino a quando i modelli di fotografia di scorta non funzioneranno?) Gli esperti hanno sollevato l’allarme negli ultimi due anni su come la falsificazione di IA potrebbe avere un impatto sulla società. Questi strumenti potrebbero essere usati per disinformazione e propaganda e potrebbero erodere la fiducia del pubblico nelle prove pittoriche, una tendenza che potrebbe danneggiare sia il sistema giudiziario che la politica. (Purtroppo, questi problemi non sono discussi nel documento di Nvidia, e quando abbiamo contattato l’azienda, ha detto che non poteva parlare del lavoro fino a quando non fosse stato correttamente sottoposto a peer-review.)

Questi avvertimenti non dovrebbero essere ignorati. Come abbiamo visto con l’uso di deepfakes per creare pornografia non consensuale , ci sono sempre persone che sono disposte a usare questi strumenti in modi discutibili. Ma allo stesso tempo, nonostante quello che dicono i profeti, l’apocalisse dell’informazione non è abbastanza vicina. Per uno, la capacità di generare volti ha ricevuto un’attenzione speciale nella comunità di IA; non puoi curare alcuna immagine in alcun modo che desideri con la stessa fedeltà. Ci sono anche seri limiti quando si tratta di esperienza e tempo. I ricercatori di Nvidia hanno impiegato una settimana a formare il loro modello su otto GPU Tesla per creare questi volti.

Ci sono anche indizi che possiamo cercare per individuare i falsi. In un recente post sul blog , l’artista e programmatore Kyle McDonald ha elencato un numero di tell. I capelli, ad esempio, sono molto difficili da falsificare. Spesso sembra troppo regolare, come se fosse stato dipinto con un pennello o troppo sfocato, confondendosi con il volto di qualcuno. Allo stesso modo, i generatori di IA non capiscono perfettamente la simmetria facciale umana. Spesso mettono le orecchie a diversi livelli o fanno occhi di colori diversi. Inoltre non sono molto bravi a generare testo o numeri, che vengono fuori come blob illeggibili.

Alcuni esempi di volti generati dall’IA con evidenti caratteristiche asimmetriche. Immagine di Kyle McDonald

Se leggi l’inizio di questo post, però, questi suggerimenti probabilmente non sono un’enorme consolazione. Dopotutto, il lavoro di Nvidia mostra quanto velocemente l’intelligenza artificiale in questo settore stia progredendo e non ci vorrà molto tempo prima che i ricercatori creino algoritmi in grado di evitare questi tell.

Per fortuna, gli esperti stanno già pensando a nuovi modi per autenticare le immagini digitali. Alcune soluzioni sono già state lanciate, ad esempio applicazioni per fotocamere che stampano immagini con codici geografici per verificare quando e dove sono state scattate. Chiaramente, ci sarà una battaglia in corso tra il falso AI e l’autenticazione delle immagini per i decenni a venire. E al momento, IA si sta caricando decisamente in testa.