Google svela nuovi micro chip AI per l’apprendimento automatico dei dispositivi

L’hardware è progettato per applicazioni aziendali, come l’automazione dei controlli di controllo qualità in fabbrica

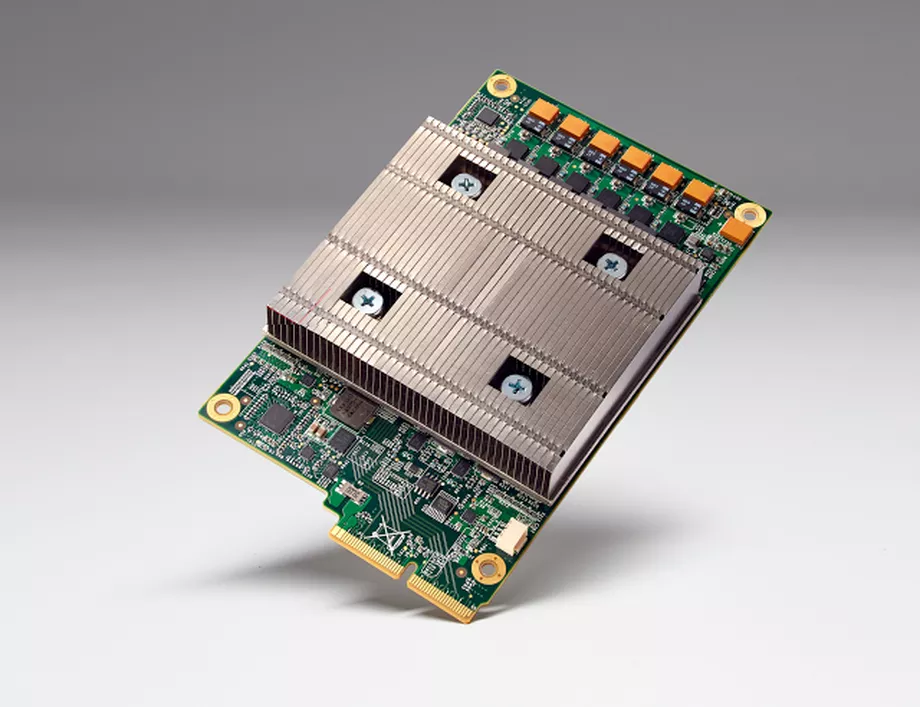

![]() Due anni fa, Google ha presentato i suoi Tensor Processing Units o TPU: chip specializzati che vivono nei data center dell’azienda e che semplificano il lavoro di intelligenza artificiale. Ora, la società sta spostando la sua esperienza di IA dal cloud e presenta il suo nuovo TPU Edge ; un piccolo acceleratore AI che eseguirà lavori di apprendimento automatico nei dispositivi IoT.

Due anni fa, Google ha presentato i suoi Tensor Processing Units o TPU: chip specializzati che vivono nei data center dell’azienda e che semplificano il lavoro di intelligenza artificiale. Ora, la società sta spostando la sua esperienza di IA dal cloud e presenta il suo nuovo TPU Edge ; un piccolo acceleratore AI che eseguirà lavori di apprendimento automatico nei dispositivi IoT.

La TPU Edge è progettata per fare ciò che è nota come “inferenza”. Questa è la parte del machine learning in cui un algoritmo svolge effettivamente il compito che è stato addestrato a fare; come, ad esempio, riconoscere un oggetto in un’immagine. Le TPU basate su server di Google sono ottimizzate per la parte relativa all’allenamento di questo processo, mentre queste nuove TPU Edge ne dedurranno l’inferenza.

Questi nuovi chip sono destinati ad essere utilizzati nei lavori aziendali, non nel prossimo smartphone. Ciò significa attività come l’automazione dei controlli di controllo qualità nelle fabbriche. Fare questo tipo di lavoro sul dispositivo ha una serie di vantaggi rispetto all’utilizzo di hardware che deve inviare dati su Internet per l’analisi. L’apprendimento automatico sul dispositivo è generalmente più sicuro; sperimenta meno tempi morti; e offre risultati più rapidi. Questo è comunque il passo delle vendite.

La TPU Edge è il fratello minore della normale unità di elaborazione del tensore, che Google utilizza per alimentare la propria intelligenza artificiale e che è disponibile per altri clienti da utilizzare tramite Google Cloud.

Google

Tuttavia, Google non è l’unica azienda che progetta chip per questo tipo di attività IA su dispositivo. ARM, Qualcomm, Mediatek e altri fanno tutti i loro acceleratori AI, mentre le GPU realizzate da Nvidia dominano il mercato degli algoritmi di allenamento.

Tuttavia, ciò che Google ha che i suoi avversari non è il controllo dell’intero stack AI. Un cliente può memorizzare i propri dati su Google’s Cloud; addestrare i loro algoritmi usando TPU; e quindi eseguire l’inferenza sul dispositivo utilizzando le nuove TPU Edge. E, più che probabile, creeranno il loro software di apprendimento automatico utilizzando TensorFlow, un framework di codifica creato e gestito da Google.

Questo tipo di integrazione verticale ha vantaggi evidenti. Google può garantire che tutte queste diverse parti si parlino l’una con l’altra nel modo più efficiente e agevole possibile, rendendo più facile per i clienti giocare (e rimanere) nell’ecosistema dell’azienda.

“I TUOI SENSORI DIVENTANO PIÙ DEI COLLETTORI DI DATI”

Injong Rhee, vice presidente di IoT di Google Cloud, ha descritto il nuovo hardware come un “chip ASIC appositamente progettato per l’esecuzione di modelli TensorFlow Lite ML ai margini” in un post sul blog . Said Rhee: “Le TPU perimetrali sono progettate per integrare la nostra offerta di TPU su cloud, in modo da poter accelerare l’allenamento ML nel cloud, quindi avere l’inferenza ML alleggerita ai margini. I tuoi sensori diventano più che raccoglitori di dati: prendono decisioni intelligenti in tempo reale “.

È interessante notare che Google sta rendendo disponibile il TPU Edge come kit di sviluppo, che renderà più semplice per i clienti testare le funzionalità dell’hardware e vedere come potrebbe adattarsi ai loro prodotti. Questo devkit include un sistema sul modulo (SOM) contenente la TPU Edge, una CPU NXP, un elemento sicuro Microchip e funzionalità Wi-Fi. Può connettersi a un computer o server tramite USB o uno slot di espansione PCI Express. Questi sviluppatori sono disponibili solo in versione beta e i potenziali clienti dovranno richiedere l’ accesso.

Questo può sembrare una piccola parte delle notizie, ma è notevole dato che Google di solito non permette al pubblico di mettere le mani sul suo hardware AI. Tuttavia, se l’azienda vuole che i clienti adottino la sua tecnologia, deve assicurarsi di poter provare prima, piuttosto che chiedere loro di fare un salto di fiducia nella IA di Googlesphere. Questa scheda di sviluppo non è solo un richiamo per le aziende: è un segno che Google è seriamente interessato a possedere l’intero stack AI.