I ricercatori propongono metodi che teoricamente garantiscono una perdita minima per gli scenari peggiori con informazioni preliminari minime per distribuzioni di premi a coda pesante

Banditi ottimali Minimax per ricompense coda pesante

Nella scienza dei dati, i ricercatori in genere si occupano di dati che contengono osservazioni rumorose. Un problema importante esplorato dai data scientist in questo contesto è il problema del processo decisionale sequenziale. Questo è comunemente noto come “bandito stocastico multi-armato” (MAB stocastico). Qui, un agente intelligente esplora e seleziona in sequenza azioni basate su ricompense rumorose in un ambiente incerto. Il suo obiettivo è ridurre al minimo il rimpianto cumulativo, la differenza tra la ricompensa massima e la ricompensa prevista delle azioni selezionate. Un rimpianto minore implica un processo decisionale più efficiente.

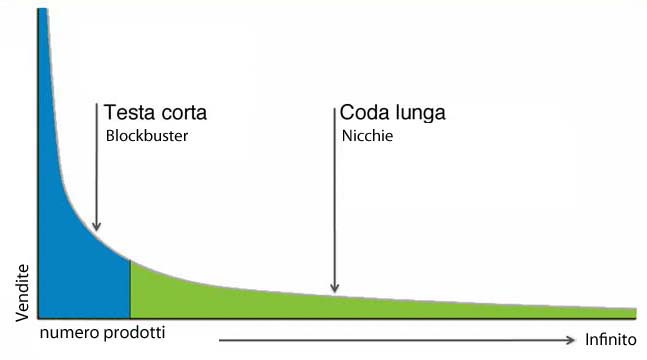

La maggior parte degli studi esistenti sui MAB stocastici ha eseguito l’analisi del rimpianto partendo dal presupposto che il rumore della ricompensa segua una distribuzione a coda leggera. Tuttavia, molti set di dati del mondo reale, infatti, mostrano una distribuzione del rumore a coda pesante. Questi includono i dati sui modelli comportamentali degli utenti utilizzati per lo sviluppo di sistemi di raccomandazione personalizzati, i dati sui prezzi delle azioni per lo sviluppo automatico delle transazioni e i dati dei sensori per la guida autonoma.

In un recente studio, l’assistente professore Kyungjae Lee della Chung-Ang University e l’assistente professore Sungbin Lim dell’Ulsan Institute of Science and Technology, entrambi in Corea, hanno affrontato questo problema. Nella loro analisi teorica, hanno dimostrato che gli algoritmi esistenti per i MAB stocastici non erano ottimali per i premi dalla coda pesante. Più specificamente, i metodi impiegati in questi algoritmi – robusto limite di confidenza superiore (UCB) e esplorazione adattativa perturbata (APE) con perturbazione illimitata – non garantiscono un’ottimalità minimax (minimizzazione della massima perdita possibile).

“Sulla base di questa analisi, sono stati proposti metodi minimax ottimali robusti (MR) UCB e APE. MR-UCB utilizza un limite di confidenza più stretto di stimatori medi robusti e MR-APE è la sua versione randomizzata. Impiega perturbazioni limitate la cui scala segue il limite di confidenza modificato in MR-UCB”, spiega il Dr. Lee, parlando del loro lavoro, che è stato pubblicato in IEEE Transactions on Neural Networks and Learning Systems il 14 settembre 2022 .

I ricercatori hanno poi derivato i limiti superiori indipendenti e dipendenti dal gap del rimpianto cumulativo. Per entrambi i metodi proposti, quest’ultimo valore corrisponde al limite inferiore sotto l’ipotesi del rumore a coda pesante, ottenendo così l’ottimalità minimax. Inoltre, i nuovi metodi richiedono informazioni preliminari minime e dipendono solo dall’ordine massimo del momento limitato delle ricompense. Al contrario, gli algoritmi esistenti richiedono a priori il limite superiore di questo momento, informazioni che potrebbero non essere accessibili in molti problemi del mondo reale.

Dopo aver stabilito il loro quadro teorico, i ricercatori hanno testato i loro metodi eseguendo simulazioni sotto i rumori di Pareto e Fréchet. Hanno scoperto che MR-UCB ha costantemente superato altri metodi di esplorazione ed è stato più robusto con un aumento del numero di azioni sotto il rumore della coda pesante.

Inoltre, il duo ha verificato il proprio approccio per i dati del mondo reale utilizzando un set di dati di criptovaluta, dimostrando che MR-UCB e MR-APE sono stati vantaggiosi (limiti di rimpianto ottimali minimimax e conoscenza preliminare minima) nell’affrontare MAB stocastico sintetico e reale dalla coda pesante. i problemi.

“Essendo vulnerabili al rumore della coda pesante, gli algoritmi MAB esistenti mostrano scarse prestazioni nella modellazione dei dati azionari. Non riescono a prevedere grandi aumenti o improvvisi cali dei prezzi delle azioni, causando enormi perdite. Al contrario, MR-APE può essere utilizzato in sistemi di trading autonomi con rendimenti attesi stabili attraverso l’investimento azionario”, commenta il dott. Lee, discutendo le potenziali applicazioni del presente lavoro. ” Inoltre, può essere applicato a sistemi di raccomandazione personalizzati poiché i dati comportamentali mostrano un rumore dalla coda pesante. Con migliori previsioni del comportamento individuale, è possibile fornire consigli migliori rispetto ai metodi convenzionali, che possono massimizzare le entrate pubblicitarie” , conclude.

Informazioni sulla Chung-Ang University

La Chung-Ang University è un’università privata di ricerca completa situata a Seoul, in Corea del Sud. È stato avviato come scuola materna nel 1916 e ha raggiunto lo status di università nel 1953. È completamente accreditato dal Ministero dell’Istruzione della Corea. La Chung-Ang University conduce attività di ricerca sotto lo slogan di “Giustizia e verità”. La sua nuova visione per il completamento dei 100 anni è “The Global Creative Leader”. La Chung-Ang University offre programmi universitari, post-laurea e dottorato, che comprendono una scuola di legge, un programma di gestione e una scuola di medicina; ha 16 scuole universitarie e di specializzazione ciascuna. I programmi culturali e artistici della Chung-Ang University sono considerati i migliori in Corea.

Informazioni sull’assistente professore Kyungjae Lee Il

professor Kyungjae Lee ha conseguito la laurea e il dottorato di ricerca. lauree in ingegneria elettrica e ingegneria informatica, rispettivamente, presso la Seoul National University, in Corea, rispettivamente nel 2015 e nel 2020. Attualmente è Assistant Professor presso il Dipartimento di Intelligenza Artificiale presso la Chung-Ang University, Seoul, Corea. I suoi attuali interessi di ricerca includono banditi multi-armati, banditi combinatori, apprendimento per rinforzo e loro applicazioni.