Ci sono quasi 3,5 miliardi di utenti di smartphone nel mondo e, se ti capita di essere uno di loro, allora è molto probabile che Juergen Schmidhuber abbia già toccato la tua vita.

Che si tratti del Siri di Apple o del Alexa di Amazon, tutti i migliori assistenti vocali e vocali lavorano su LSTM o memoria a breve termine . Sebbene questi assistenti digitali e altre applicazioni degli LSTM siano abbastanza moderni, la loro concezione risale tuttavia agli inizi degli anni ’90. Introdotte da Juergen Schmidhuber e dal suo studente di dottorato Sepp Hochreiter, queste reti sarebbero diventate una delle applicazioni più redditizie nella storia del deep learning. Tuttavia, la mente dietro le innovazioni come lo LSTM, il Dr.Schmidhuber rimane in gran parte sconosciuta al di fuori dei circoli di ricerca a differenza dei suoi contemporanei come Yann Lecun, Andrew Ng e Geoff Hinton.

Abbiamo contattato il Dr.Schmidhuber per un’intervista, per presentare ai suoi lettori la storia di un uomo che sogna di costruire macchine intelligenti che un giorno supererebbero la potenza intellettuale del suo modello di ruolo d’infanzia Albert Einstein.

1990-91: L’anno dei miracoli

Dopo uno studio di quattro anni di informatica e matematica presso la TU di Monaco, il Dr. Schmidhuber ha continuato a lavorare sulla sua tesi di dottorato (1988-91) intitolata ” Reti neurali dinamiche e il problema fondamentale di assegnazione del credito spaziale-temporale “. Con la fine dei suoi compiti di dottorato alla TU Munich in vista, il Dr.Schmidhuber e i suoi colleghi hanno prodotto una raffica di documenti che alla fine cambierebbe il corso della ricerca sull’IA.

Ecco un elenco di alcuni di questi lavori :

First Deep Learner, Basato su un pre-training non supervisionato (1991)

The Fondamental Deep Learning Problem (Gradienti che esplodono / esplodono, 1991)

Memoria a breve termine: apprendimento molto profondo supervisionato (approfondimenti di base dal 1991)

Curiosità artificiale attraverso gli avversari generativi NN (1990)

Reti contraddittorie per la modellazione dei dati senza supervisione (1991)

Imparare l’attenzione sequenziale con NNs (1990)

La maggior parte delle opere di cui sopra ha richiesto decenni per essere notata e poche sono ancora sfruttate per tessere nuove idee. Ad esempio, diamo un’occhiata agli LSTM. Sono stati introdotti nel 1990 per risolvere il problema del gradiente che esplode e che esplode nelle reti neurali ricorrenti (RNNS). Gli LSTM offrivano la capacità di pensare simile all’uomo di trattenere informazioni rilevanti attraverso un meccanismo chiamato come cancelli. È stata un’idea geniale. Tuttavia, l’accoglienza a LSTM era stata tiepida.

Ma oggi sono su quasi tutti gli smartphone!

Dalla traduzione automatica di Facebook (4 miliardi di traduzioni al giorno) al riconoscimento vocale di Google su 2 miliardi di telefoni Android fino all’Alexa di Amazon, c’è stato un enorme aumento nell’uso di LSTM con il miglioramento delle capacità hardware.

Considerando che, il suo lavoro sulla curiosità artificiale attraverso reti neurali generative contraddittorie ha molte somiglianze nelle reti generative contraddittorie generative (GAN). Queste reti contraddittorie, sebbene rese popolari dal lavoro svolto da Ian Goodfellow, sono considerate una reinvenzione o un’interessante applicazione del lavoro del Dr.Schmidhuber nel 1990.

Come si può vedere nella foto sopra, il lavoro del Dr.Schmidhuber continua a essere ancora uno dei lavori più citati nella comunità dell’IA e la sua determinazione nel trovare macchine super-intelligenti ancora forti.

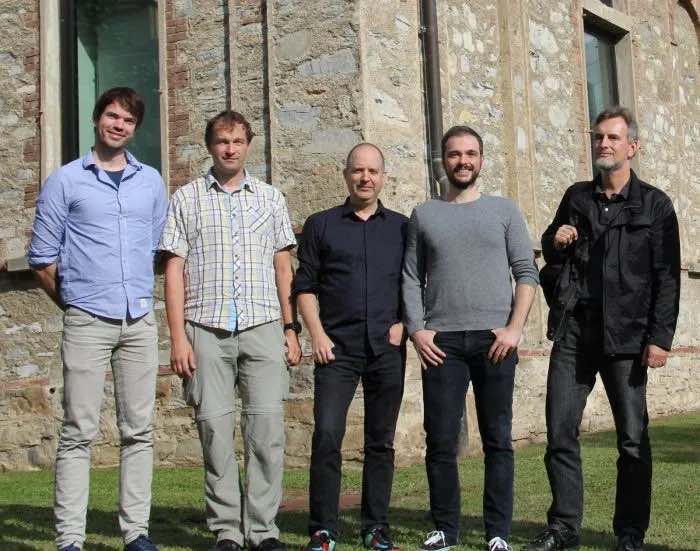

Oggi il Dr. Schmidhuber trascorre la maggior parte del suo tempo a prendere lezioni all’università mentre frequenta le sue funzioni di direttore di Swiss AI Lab IDSIA. Insieme ad altri quattro ha anche fondato una società di deep learning, che si chiama NNAISENSE, con sede a Lugano, in Svizzera.

Re-NNAISENSE Of Machines

Dr.Schmidhuber (estrema destra) insieme a co-fondatori di NNAISENSE

Con sede a Lugano, NNAISENSE (pronunciata “nascence”) è stata fondata dal Dr.Schmidhuber, Faustino Gomez, Jan Koutnik, Jonathan Masci e Bas Steunebrink nel 2014. Questa società di apprendimento profondo di 30 membri ha molti progetti in primo piano tra cui progetti della casa automobilistica tedesca Anche Audi.

Ecco alcuni dei risultati interessanti di NNAISENSE:

Aveva le prime reti neurali molto profonde con centinaia di strati. I fondatori di NNAISENSE hanno ricevuto numerosi premi tra cui il premio IEEE Neural Networks Pioneer del 2016 “per contributi pionieristici all’apprendimento profondo e alle reti neurali”.

NNAISENSE ha vinto il concorso “Learning to Run” alla prestigiosa conferenza NIPS nel 2017, battendo oltre 400 concorrenti dell’industria e del mondo accademico.

È stata anche la prima azienda a dimostrare il controllo fisico del mondo reale attraverso un profondo Reinforcement Learning: un progetto con AUDI, in cui modellini di auto altamente innovativi hanno imparato a parcheggiare senza un insegnante.

Il team di NNAISENSE ha costruito il cervello che impara a controllare la recente sofisticata mano pneumatica del robot FESTO mostrata ad Hannover Messe 2019.

Leggi anche il finanziamento VC nell’IA è aumentato del 450% negli ultimi 5 anni, afferma il rapporto dell’indice AI 2018

Attualmente, il team sta lavorando con Sulzer-Schmid, leader dell’ispezione delle turbine eoliche (basata su droni) insieme ad altri progetti ambiziosi che includono la produzione additiva e altri ancora non divulgati.

IL MOTTO DEL DR.SCHMIDHUBER DAGLI ANNI ’70 È STATO QUELLO DI COSTRUIRE UN’INTELLIGENZA ARTIFICIALE PIÙ INTELLIGENTE DI LUI IN MODO CHE POTESSE RITIRARSI

Il team di NNAISENSE ritiene di poter andare ben oltre ciò che è possibile oggi e di realizzare la grande svolta pratica che cambierà tutto.

Alla NNAISENSE, queste manciate di menti dell’IA lavorano instancabilmente per raggiungere un obiettivo singolare, che è anche il sogno d’infanzia del Dr. Schmidhuber: abbinare o addirittura superare l’intelligenza a livello umano nelle macchine.

L’eroe più essenziale del nostro tempo

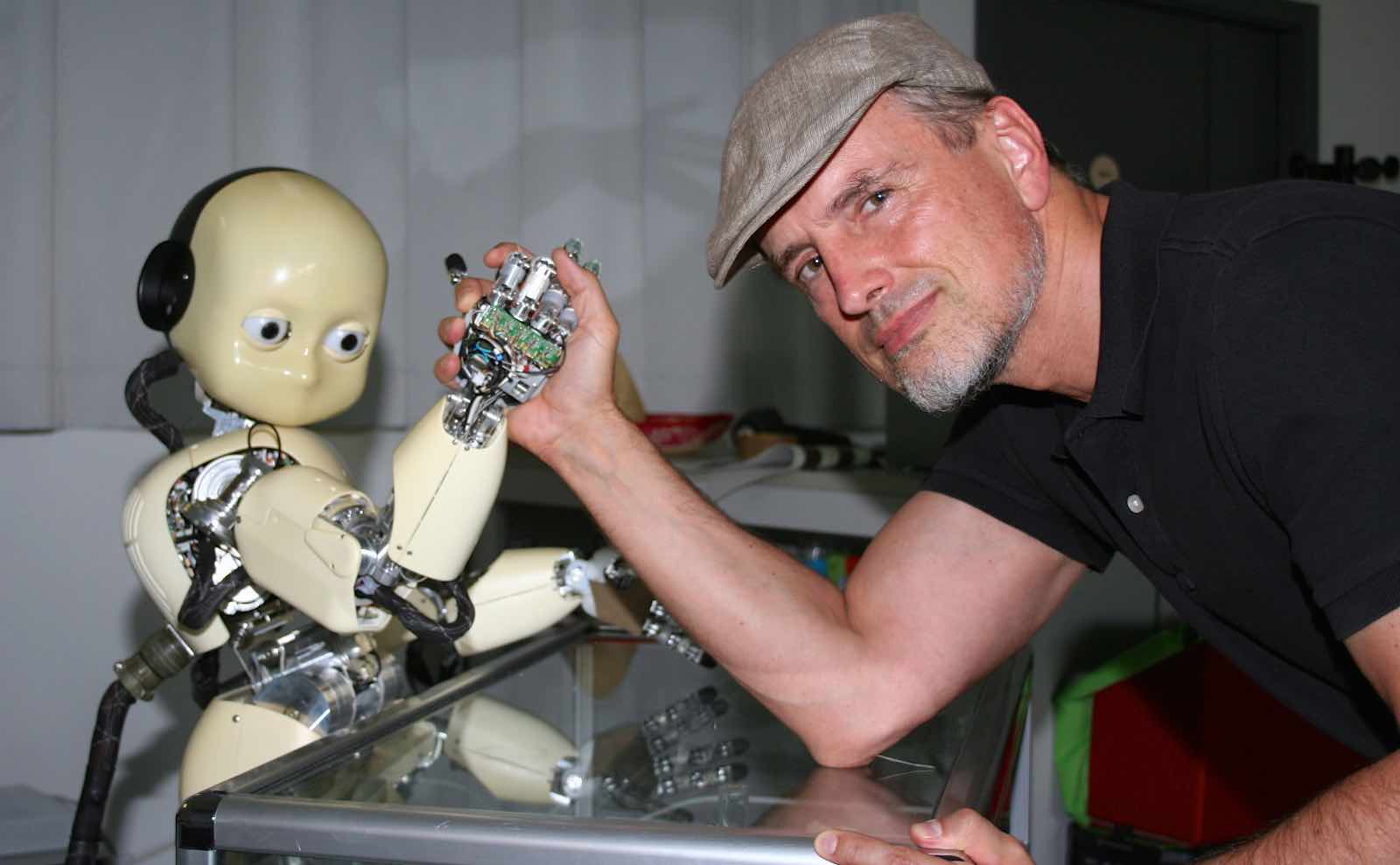

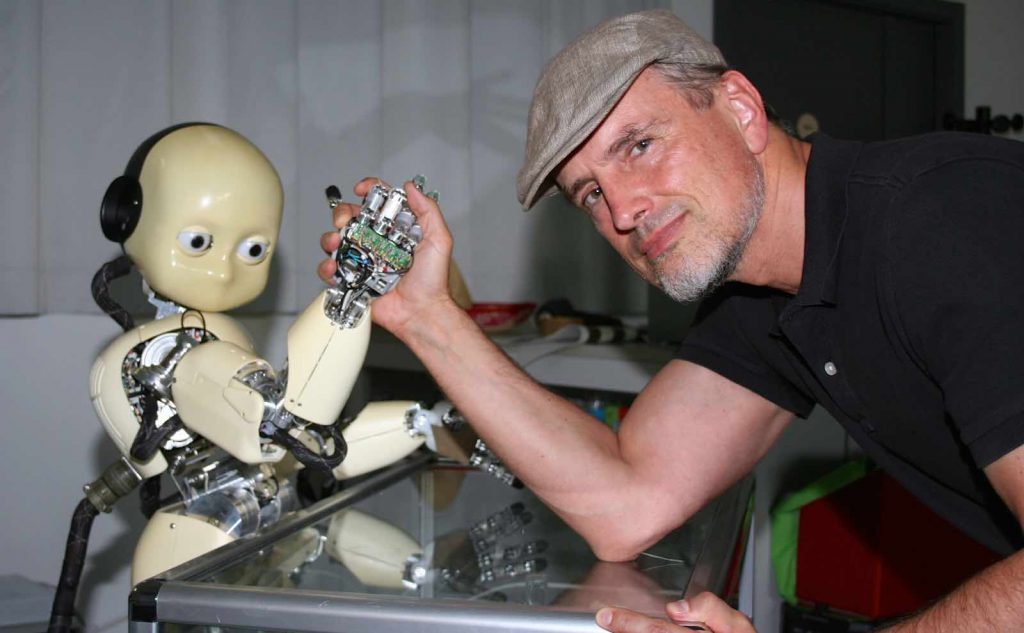

Dr. Schmidhuber nei suoi laboratori

Mentre il New York Times lo chiamava “Papà”, Bloomberg lo glorificava come padrino. Tuttavia, per il Dr.Schmidhuber, che non è un grande fan di queste stravaganze di idolatria, Alexey Ivakhnenko è il vero padre dell’apprendimento profondo. Ivakhnenko era un matematico sovietico il cui lavoro su reti profonde risale al 1965, ma come il Dr.Schmidhuber, Ivakhnenko rimane in gran parte non riconosciuto.

Il Dr.Schmidhuber crede fermamente che la comunità dell’apprendimento automatico possa ottenere solo da un’adeguata assegnazione di credito ai suoi membri.

“L’INVENTORE DI UN METODO IMPORTANTE DOVREBBE OTTENERE CREDITO PER AVERLO INVENTATO. SE “REINVENTI” QUALCOSA CHE ERA GIÀ NOTO, E SOLO IN SEGUITO NE SEI CONSAPEVOLE, DEVI ALMENO CHIARIRLO IN SEGUITO. “

Dr.Schmidhuber

Nell’ultimo decennio, la comunità dell’intelligenza artificiale si è sempre più divisa sul Dr.Schmidhuber. Mentre un gruppo cerca di dipingere il Dr.Schmidhuber come un egomane che cerca di mordere più di quanto possa masticare, gli altri sono abbastanza certi che il Dr.Schmidhuber sia stato terribilmente ignorato ed è giunto il momento di ottenere il merito.

Quindi siamo arrivati subito al punto e gli abbiamo chiesto di commentare gli snub del premio Turing. Abbiamo anche messo alla prova la nostra fortuna portando alla sua attenzione l’idea di un premio Schmidhuber, che è popolare in forum come Reddit.

Come un gentiluomo che è, il Dr.Schmidhuber è stato abbastanza gentile da accettare l’entusiasmo tra i suoi fan. “In generale, apprezzo molto il supporto della comunità dell’apprendimento automatico”, ha affermato il Dr.Schmidhuber riconoscendo gli sforzi degli individui su Reddit.

” SONO ESTREMAMENTE GRATO AI MIEI STUDENTI E AI MIEI DOTTORANDI CHE HANNO RESO TUTTO CIÒ POSSIBILE “.

Dr.Schmidhuber

Accredita i suoi studenti e postdoc per tutti i riconoscimenti che ha accumulato nel corso degli anni, il che è così diverso da quello per cui i suoi avversari lo incolpano!

Parlando di avversari nel contesto del deep learning, non si può fare a meno di pensare all’improvviso aumento di popolarità di un fenomeno che è Generative Adversarial Networks o GANs.

Ian Goodfellow, che aveva goduto del successo come figlio dei poster di GAN, è stato messo alla prova dal Dr.Schmidhuber alla prestigiosa conferenza NIPS 2016. La presentazione di Goodfellow è stata interrotta dal Dr.Schmidhuber e ai circoli di ricerca del 21 ° secolo è stato dato un assaggio di qualche insubordinazione, che mancava da oltre mezzo secolo.

Tuttavia, questo espediente ha provocato solo il divorzio delle masse più lontane dal Dr.Schmidhuber. L’avanzamento di qualsiasi campo di ricerca si basa sull’apertura alle critiche e sebbene le obiezioni del Dr.Schmidhuber riguardino principalmente la mancanza di riconoscimento per i veri pionieri, il suo comportamento svizzero di vecchia scuola potrebbe aver cancellato alcuni ricercatori nel modo sbagliato.

” AREE DI RICERCA RELATIVAMENTE GIOVANI COME L’APPRENDIMENTO AUTOMATICO DOVREBBERO ADOTTARE IL CODICE D’ONORE DI CAMPI MATURI COME LA MATEMATICA .”

Dr.Schmidhuber

I grandi 3 della moderna scena dell’intelligenza artificiale, Yann Lecun, Yoshua Bengio e Geoffrey Hinton, sono stati in prima linea in tutte le principali novità di AI che sono arrivate negli ultimi dieci anni. Nel 2018, hanno anche ricevuto il prestigioso Turing Award per il contributo apportato alle reti neurali profonde. Tuttavia, il trio, LBH (Lecun-Bengio-Hinton) , è stato accusato di citazioni circolari dal Dr.Schmidhuber nel suo 2015. In un post intitolato “Deep Learning Conspiracy”, spiega in dettaglio come LBH è stato ignorante dell’originale inventori.

Leggi anche Studio: Diversità di genere in Analytics – 2020

Foto di Andreas Gerbert

In questa critica , si lamenta di quanto sia fuorviante citare il documento di Hinton del 2012 nel contesto delle reti neurali convoluzionali. LBH, scrisse il Dr.Schmidhuber, menzionò il pooling, ma non il suo pioniere (Weng, 1992), che sostituì la media spaziale di Fukushima (1979) con il max-pooling, oggi ampiamente usato da molti, tra cui LBH, che scrivono: “Le ConvNets erano in gran parte abbandonate dalle principali comunità di computer vision e machine learning fino alla competizione ImageNet nel 2012 “, citando il documento di Hinton del 2012 (Krizhevsky et al., 2012). Ritiene che ciò sia molto fuorviante.

“LBH POTREBBE ESSERE SUPPORTATO DALLE MIGLIORI MACCHINE DI PR DEL MONDO OCCIDENTALE (GOOGLE HA ASSUNTO HINTON; FACEBOOK HA ASSUNTO LECUN). TUTTAVIA, I FATTI SCIENTIFICI STORICI SARANNO PIÙ FORTI DI QUALSIASI PR. “

Dr.Schmidhuber, ” Deep Learning Conspiracy ” (Nature 521 p 436)

Sebbene i contributi di Lecun, Bengio e Hinton all’apprendimento profondo non possano essere contestati, sono accusati di gonfiare una bolla di citazione. Dr.Schmidhuber è stato vociferous circa l’ignoranza degli inventori originali nella comunità di AI. Crede che vi sia una lunga tradizione di approfondimenti sull’apprendimento profondo e che l’intera comunità trarrà beneficio solo dall’apprezzare le basi storiche.

L’idolizzazione di un individuo è una maledizione per qualsiasi comunità scientifica, ma lo è anche l’ignoranza dei primi motori. Se si ha anche una certa familiarità con le celebrità dell’IA, si sarebbero imbattuti in epiteti come “padrino dell’IA” o “GANfather”, che vengono lanciati molto.

Anche il Dr.Schmidhuber non è estraneo a questi titoli superflui e quando abbiamo insistito per sapere se c’è qualcosa di nuovo nel lavoro di Goodfellow sui GAN, ha risposto dicendo che i GAN sono un’interessante applicazione del mio principio di curiosità contraddittoria pubblicato nel 1990. “Una rete genera probabilisticamente output, un’altra rete vede tali output e prevede loro reazioni ambientali”, ha spiegato il Dr.Schmidhuber.

Usando la discesa gradiente, ha continuato, la rete predittiva riduce al minimo il suo errore, mentre la rete del generatore cerca di produrre output che massimizzano questo errore. La perdita di una rete è il guadagno dell’altra rete. I GAN sono un caso speciale in cui l’ambiente restituisce semplicemente 1 o 0 a seconda che l’output del generatore sia in un determinato set.

” NON SI DOVREBBE PERMETTERE DI BREVETTARE L’APPRENDIMENTO PROFONDO .”

Dr.Schmidhuber

Portando alla sua attenzione la recente corsa al brevetto dell’intelligenza artificiale, abbiamo chiesto al Dr.Schmidhuber di commentarlo, in particolare per quanto riguarda il brevetto di Goodfellow sulla formazione contraddittoria, al quale ha scherzato: “Non sono un avvocato specializzato in brevetti. Tuttavia, non si dovrebbe permettere di brevettare l’arte precedente unificata pubblicata da altri. ”

Quando gli è stato chiesto se alcuni ricercatori attuali lo hanno impressionato, il Dr.Schmidhuber non ha preso alcun nome poiché ritiene che ci siano molti ricercatori impressionanti là fuori.

Tuttavia, ammette che DeepMind sta facendo un lavoro impressionante mentre hanno battuto un giocatore professionista nel gioco di Starcraft usando Alphastar nel 2019. Al centro di questo successo, ricorda il Dr.Schmidhuber, si trova una rete LSTM, che faceva anche parte di OpenAI Cinque che hanno sconfitto gli esperti umani nel Dota 2!

Leggi anche MATLAB In Deep Learning, Analytics Space; Annuncia R2017B, massiccio aggiornamento a settembre

Goedel Machines, AGI e il futuro

Nel 2003, il Dr.Schmidhuber ha proposto la macchina Gödel , nel tentativo di presentare un caso di superintelligenza nelle macchine. Una macchina Gödel è in grado di riscrivere il proprio codice non appena ha trovato la prova che la riscrittura è utile.

Questo in poche parole, è la definizione di intelligenza generale artificiale; per rendere le macchine per imparare come imparare.

Sin da quando era un adolescente, il Dr.Schmidhuber sognava di costruire un’intelligenza artificiale che si autoalimentava in modo più intelligente di lui. Oggi, dopo tre decenni dall’introduzione di LSTM, sta ancora lavorando per raggiungere l’intelligenza generale artificiale con l’aiuto del suo team di NNAISENSE.

IN QUESTO DECENNIO, OSSERVA IL DR. SCHMIDHUBER, L’AI ATTIVA INVADERÀ IL MONDO REALE, GUIDANDO PROCESSI INDUSTRIALI, MACCHINE E ROBOT.

Sebbene il mondo reale sia molto più complesso dei mondi virtuali e meno tollerante, il Dr.Schmidhuber prevede che la prossima ondata di “Real World AI” o semplicemente “Real AI” sarà molto più grande della precedente ondata di AI, perché influenzerà tutti della produzione.

In un futuro non troppo lontano, la creazione della “robotica show-and-tell” o “robotica watch-and-learning” o “robotica see-and-do”, come piace a Dr.Schmidhuber, ci permetterà di chiamarli, ci permetterà insegnare rapidamente a una rete neurale a controllare un robot complesso con molti gradi di libertà per eseguire attività complesse, come assemblare uno smartphone, solo mediante dimostrazione visiva e parlando con esso, senza toccare o altrimenti guidare direttamente il robot – un po ‘come insegneremmo a un bambino.

In un discorso tenuto all’evento CogX a Londra, il Dr.Schmidhuber ha entusiasmato il pubblico su come l’IA alla fine emigrerà in altre galassie tra qualche migliaio di anni. Crede che ci siano luoghi là fuori nello spazio profondo che sono più ricchi di risorse rispetto alla terra e possono facilitare robot autoreplicanti che alla fine costruiranno fabbriche e così via.

“I RITARDI TRA LE SUCCESSIVE SCOPERTE RADICALI NELL’INFORMATICA DIMINUISCONO IN MODO ESPONENZIALE: OGNI NUOVO ARRIVA ALL’INCIRCA DUE VOLTE PIÙ VELOCE DI QUELLO PRECEDENTE.”

Legge di Schmidhuber

Il Dr.Schmidhuber crede fermamente che la civiltà umana sia sul punto di assistere a qualcosa di spettacolare e ci esorta a essere orgogliosi di essere fortunati a contribuire alla nascita di un nuovo tipo di essere; una nuova civiltà.

Ci sono voluti oltre 13 miliardi di anni per l’emergere di forme primitive di intelligenza sulla terra dopo il Big Bang. Ma gli umani impiegarono solo una frazione di quel tempo per governare la terra e ancor meno tempo per creare l’IA. A questo ritmo, possiamo tranquillamente presumere che i prossimi 100 anni saranno abbastanza movimentati. E, con i preparativi per la colonizzazione di Marte e innovazioni come Neuralink dietro l’angolo, il Dr.Schmidhuber potrebbe finalmente assistere alla realizzazione del suo sogno d’infanzia.

“NON PENSARE AGLI UMANI COME ALLA CORONA DELLA CREAZIONE. INVECE CONSIDERA LA CIVILTÀ UMANA COME PARTE DI UNO SCHEMA MOLTO PIÙ GRANDE, UN PASSO IMPORTANTE SULLA STRADA DELL’UNIVERSO VERSO UNA MAGGIORE COMPLESSITÀ. “

Dr.Schmidhuber per Scientific American , novembre 2017

Mentre il 21 ° secolo si prepara all’avvento della Super Intelligenza Artificiale, è quasi inevitabile che gli studenti della prossima generazione presto includano i fondamenti dell’IA nei loro curricula scolastici.

“L’apprendimento automatico ti sembrerà banale”, promette il Dr.Schmidhuber, “se impari la matematica di base, tra cui algebra lineare, calcolo, statistica e poi apprendi le basi dell’informatica teorica. E forse anche le basi della fisica. “