Lo stravagante studio di Stanford sul riconoscimento facciale afferma che ci sono collegamenti tra i tratti del viso e l’orientamento politico

Unisciti a noi per l’evento leader mondiale sull’accelerazione della trasformazione aziendale con AI e dati, per i responsabili delle decisioni tecnologiche aziendali, presentato dall’editore numero 1 in AI e dati

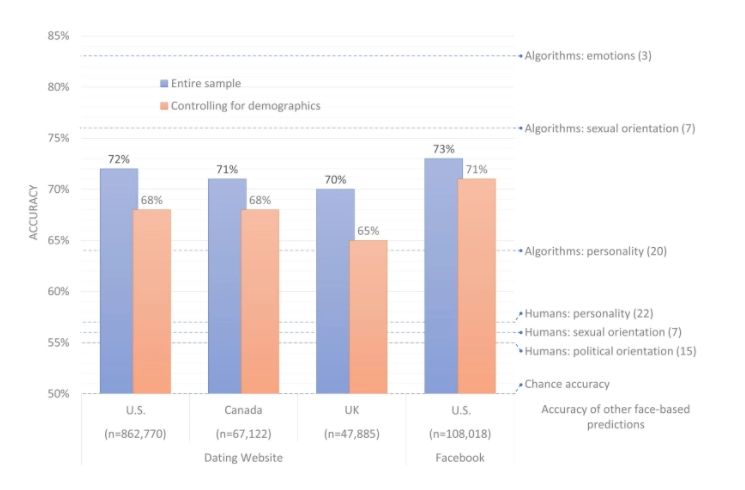

Un articolo pubblicato oggi sulla rivista Scientific Reports dal controverso ricercatore affiliato a Stanford Michal Kosinski afferma di dimostrare che gli algoritmi di riconoscimento facciale possono esporre le opinioni politiche delle persone dai loro profili sui social media. Utilizzando un set di dati di oltre 1 milione di profili di Facebook e siti di incontri di utenti in Canada, Stati Uniti e Regno Unito, Kosinski e coautori affermano di aver addestrato un algoritmo per classificare correttamente l’orientamento politico nel 72% delle coppie di volti “liberali-conservatori”.

Il lavoro, nel suo insieme, abbraccia il concetto pseudoscientifico di fisionomia, ovvero l’idea che il carattere o la personalità di una persona possa essere valutata dal suo aspetto. Nel 1911, l’antropologo italiano Cesare Lombroso pubblicò una tassonomia che dichiarava che “quasi tutti i criminali” hanno “orecchie a brocca, capelli folti, barbe sottili, seni pronunciati, menti sporgenti e zigomi larghi”. I ladri erano famosi per i loro “piccoli occhi vaganti”, ha detto, e gli stupratori per le loro “labbra e palpebre gonfie”, mentre gli assassini avevano un naso che era “spesso simile a un falco e sempre grande”.

La frenologia, un campo correlato, prevede la misurazione di protuberanze sul cranio per prevedere i tratti mentali. Gli autori che rappresentano l’Institute of Electrical and Electronics Engineers (IEEE) hanno affermato che questo tipo di riconoscimento facciale è “necessariamente destinato a fallire” e che affermazioni forti sono il risultato di una progettazione sperimentale scadente.

Anche il professore di Princeton Alexander Todorov , critico del lavoro di Kosinski, sostiene che metodi come quelli impiegati nel documento di riconoscimento facciale sono tecnicamente difettosi. Dice che i modelli raccolti da un algoritmo che confronta milioni di foto potrebbero avere poco a che fare con le caratteristiche del viso. Ad esempio, le foto autopubblicate sui siti di incontri proiettano una serie di indizi non facciali.

Inoltre, l’attuale ricerca psicologica mostra che dall’età adulta, la personalità è per lo più influenzata dall’ambiente. “Sebbene sia potenzialmente possibile prevedere la personalità da una foto, nel migliore dei casi è leggermente migliore del caso nel caso degli esseri umani”, Daniel Preotiuc-Pietro, un ricercatore post-dottorato presso l’Università della Pennsylvania che ha lavorato sulla previsione della personalità dalle immagini del profilo, ha detto a Business Insider in una recente intervista.

Difendere la pseudoscienza

Kosinski e coautori, rispondendo preventivamente alle critiche, si sforzano di prendere le distanze dalla frenologia e dalla fisionomia. Ma non li licenziano del tutto. “La fisionomia si basava su studi non scientifici, superstizione, prove aneddotiche e pseudo-teorie razziste. Il fatto che le sue affermazioni non fossero supportate, tuttavia, non significa automaticamente che siano tutte sbagliate ”, hanno scritto in note pubblicate insieme al giornale. “Alcune delle affermazioni dei fisionomisti potrebbero essere state corrette, forse per un semplice incidente.”

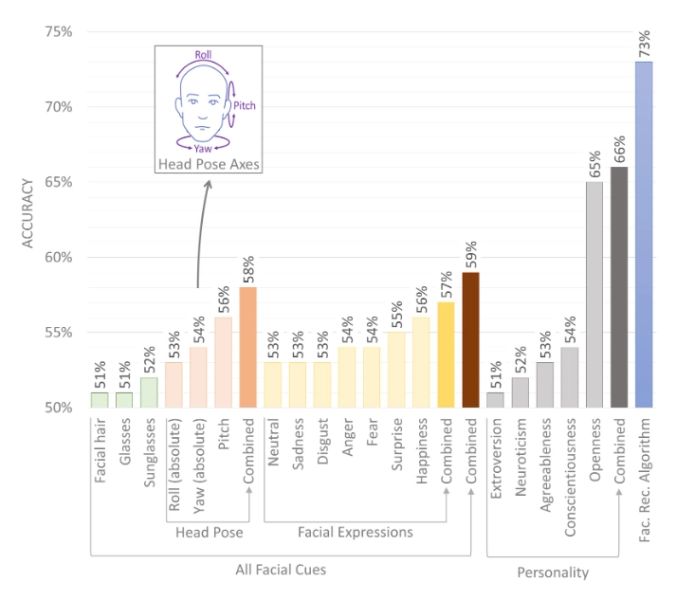

Secondo i coautori, una serie di caratteristiche facciali, ma non tutte, rivelano l’appartenenza politica, tra cui l’orientamento della testa, l’espressione emotiva, l’età, il sesso e l’etnia. Mentre i peli sul viso e gli occhiali predicono l’affiliazione politica con “precisione minima”, i liberali tendono ad affrontare la telecamera in modo più diretto e hanno maggiori probabilità di esprimere sorpresa (e meno probabilità di esprimere disgusto), dicono.

“Mentre tendiamo a pensare ai tratti del viso come relativamente fissi, ci sono molti fattori che li influenzano sia a breve che a lungo termine”, hanno scritto i ricercatori. “I liberali, ad esempio, tendono a sorridere in modo più intenso e genuino, il che porta alla comparsa di diversi modelli di rughe espressive. I conservatori tendono ad essere più sani, consumano meno alcol e tabacco e hanno una dieta diversa, il che, nel tempo, si traduce in differenze nella salute della pelle e nella distribuzione e quantità di grasso facciale “.

I ricercatori ipotizzano che l’aspetto del viso predice i risultati della vita come la durata di una pena detentiva, il successo professionale, i risultati scolastici, le possibilità di vincere un’elezione e il reddito e che questi risultati a loro volta influenzano probabilmente l’orientamento politico. Ma ipotizzano anche che ci sia una connessione tra l’aspetto del viso e l’orientamento politico e i geni, gli ormoni e l’esposizione prenatale alle sostanze.

“Le prime impressioni negative potrebbero nel corso della vita di una persona ridurre il loro potenziale di guadagno e lo status e quindi aumentare il loro sostegno alla ridistribuzione della ricchezza e la sensibilità all’ingiustizia sociale, spostandole verso l’estremità liberale dello spettro politico”, hanno scritto i ricercatori. “I livelli di testosterone prenatale e postnatale influenzano la forma del viso e sono in correlazione con l’orientamento politico. Inoltre, l’esposizione prenatale alla nicotina e all’alcol influenza la morfologia del viso e lo sviluppo cognitivo (che è stato collegato all’orientamento politico) “.

Kosinski e coautori hanno rifiutato di rendere disponibile il codice sorgente o il set di dati del progetto, citando le implicazioni sulla privacy. Ma questo ha il duplice effetto di rendere impossibile l’auditing del lavoro per bias e difetti sperimentali. La scienza in generale ha un problema di riproducibilità – un sondaggio del 2016 di 1.500 scienziati ha riferito che il 70% di loro aveva provato ma non è riuscito a riprodurre almeno un esperimento di un altro scienziato – ma è particolarmente acuto nel campo dell’IA. Un recente rapporto ha rilevato che dal 60% al 70% delle risposte fornite dai modelli di elaborazione del linguaggio naturale erano incorporate da qualche parte nei set di formazione di benchmark, indicando che i modelli spesso memorizzavano semplicemente le risposte.

Numerosi studi, tra cui il famoso lavoro Gender Shades di Joy Buolamwini, Dr.Timnit Gebru, Dr.Helen Raynham e Deborah Raji, e le analisi di VentureBeat sui dati di benchmark pubblici hanno dimostrato che gli algoritmi di riconoscimento facciale sono suscettibili a vari pregiudizi. Un elemento di confusione frequente è la tecnologia e le tecniche che favoriscono la pelle più chiara, che includono di tutto, dalle pellicole color seppia alle fotocamere digitali a basso contrasto. Questi pregiudizi possono essere codificati in algoritmi in modo tale che le loro prestazioni su persone con la pelle più scura siano inferiori a quelle su quelle con la pelle più chiara.

Il bias è pervasivo negli algoritmi di apprendimento automatico oltre a quelli che alimentano i sistemi di riconoscimento facciale. Un’indagine di ProPublica ha scoperto che il software utilizzato per prevedere la criminalità tende a mostrare pregiudizi contro i neri . Un altro studio ha rilevato che alle donne viene mostrato meno annunci online per lavori ben pagati . Un concorso di bellezza AI era prevenuto a favore dei bianchi . E un algoritmo utilizzato da Twitter per decidere come le foto vengono ritagliate nelle sequenze temporali delle persone elette automaticamente per visualizzare i volti dei bianchi su quelli con la pigmentazione della pelle più scura.

Eticamente discutibile

Kosinski, il cui lavoro di analisi della connessione tra i tratti della personalità e l’attività di Facebook ha ispirato la creazione della società di consulenza politica Cambridge Analytica, non è estraneo alle polemiche. In un articolo pubblicato nel 2017 , lui e l’informatico di Stanford Yilun Wang hanno riferito che un sistema di intelligenza artificiale standard era in grado di distinguere tra foto di persone gay e eterosessuali con un alto grado di precisione. Gruppi di difesa come Gay & Lesbian Alliance Against Defamation (GLAAD) e Human Rights Campaign hanno affermato che lo studio “minaccia la sicurezza e la privacy delle persone LGBTQ e non LGBTQ allo stesso modo”, osservando che ha trovato basi nella controversa teoria dell’orientamento sessuale prenatale. , che prevede l’esistenza di legami tra l’aspetto del viso e l’orientamento sessuale determinati dall’esposizione precoce agli ormoni.

Todorov crede che la ricerca di Kosinski sia “incredibilmente discutibile dal punto di vista etico” in quanto potrebbe dare credibilità a governi e aziende che potrebbero voler utilizzare tali tecnologie. Lui e accademici come il ricercatore di scienze cognitive Abeba Birhane sostengono che coloro che creano modelli di IA devono prendere in considerazione i contesti sociali, politici e storici. Nel suo articolo ” Algorithmic Injustices: Towards a Relational Ethics “, per il quale ha vinto il Best Paper Award a NeurIPS 2019, Birhane ha scritto che “le preoccupazioni relative al processo decisionale algoritmico e all’ingiustizia algoritmica richiedono un ripensamento fondamentale al di là delle soluzioni tecniche”.

In un’intervista con Vox nel 2018, Kosinski ha affermato che il suo obiettivo principale era cercare di comprendere le persone, i processi sociali e il comportamento attraverso la lente delle “impronte digitali”. Industrie e governi stanno già utilizzando algoritmi di riconoscimento facciale simili a quelli che ha sviluppato, ha affermato, sottolineando la necessità di avvertire le parti interessate sull’estinzione della privacy.

“L’uso diffuso della tecnologia di riconoscimento facciale pone rischi drammatici per la privacy e le libertà civili”, hanno scritto Kosinski e coautori di questo ultimo studio. “Mentre molte altre impronte digitali rivelano l’orientamento politico e altri tratti intimi, il riconoscimento facciale può essere utilizzato senza il consenso o la conoscenza dei soggetti. Le immagini del viso possono essere facilmente (e di nascosto) prese dalle forze dell’ordine o ottenute da archivi digitali o tradizionali, inclusi social network, piattaforme di appuntamenti, siti Web di condivisione di foto e database governativi. Sono spesso facilmente accessibili; Le immagini del profilo Facebook e LinkedIn, ad esempio, possono essere consultate da chiunque senza il consenso o la conoscenza di una persona. Pertanto, le minacce alla privacy poste dalla tecnologia di riconoscimento facciale sono, per molti versi, senza precedenti “.

In effetti, aziende come Faception affermano di essere in grado di individuare terroristi, pedofili e altro utilizzando il riconoscimento facciale. E il governo cinese ha utilizzato il riconoscimento facciale per le fotografie di identità di centinaia di sospetti criminali, apparentemente con una precisione superiore al 90% .

Esperti come Os Keyes, Ph.D. candidato e ricercatore di intelligenza artificiale presso l’Università di Washington, concorda sull’importanza di attirare l’attenzione sugli usi impropri e sui difetti del riconoscimento facciale. Ma Keyes sostiene che studi come quello di Kosinski promuovono ciò che è fondamentalmente scienza spazzatura. “Attingono a molti (francamente, inquietanti) studi di biologia evolutiva e sessuologia che trattano la queerness [per esempio] come originata da testosterone ‘troppo’ o ‘non abbastanza’ nell’utero”, hanno detto a VentureBeat in una e-mail. “Dipendere da loro e approvarli in uno studio … è assolutamente sconcertante.”

Kyle Wiggers da venturebeat.com