Mentre Netflix continua ad espandere la sua portata globale, il pubblico è diventato piuttosto globale. Il pubblico sta benissimo guardando un programma TV girato in una lingua straniera. Netflix è riuscito in qualche modo a superare la barriera linguistica, ma la sfida ora sta nel garantire che le traduzioni siano accurate.

Netflix ha messo in atto un processo rigoroso per scartare i sottotitoli non accurati, ma ciò non aiuta ancora. Quindi, un gruppo di ricercatori ML di Netflix ha introdotto un nuovo approccio per affrontare questo problema. Chiamano questo approccio Pre-elaborazione automatica o APP. Questo processo, sostengono i ricercatori, fornirà traduzioni vicine a quelle della lingua madre.

Panoramica del modello

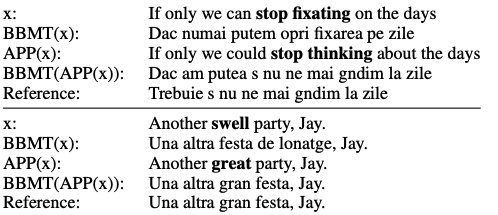

La qualità della traduzione per la traduzione a bassa risorsa (cioè dall’inglese in una lingua a bassa risorsa) nell’impostazione MT-black-box (BBMT) è impegnativa. Quindi, i ricercatori di Netflix hanno introdotto un metodo per migliorare tali sistemi tramite la pre-elaborazione automatica (APP) usando la semplificazione delle frasi.

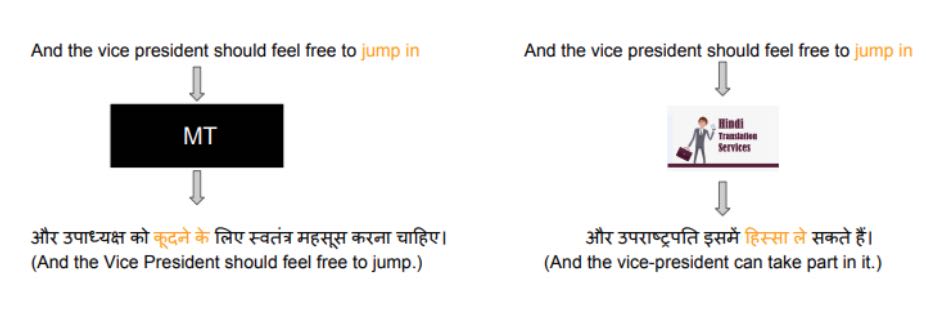

Ad esempio, se una frase sorgente dice ” Il vicepresidente dovrebbe sentirsi libero di entrare” e deve essere tradotto in hindi, usando Google Translate si otterrà “Il vicepresidente dovrebbe sentirsi libero di saltare dentro . “Il sistema, afferma il team di Netflix, non è stato in grado di tradurre correttamente la frase idiomatica e non compositiva” saltare dentro “.

I sistemi di traduzione automatica (MT) addestrati su set di addestramento più piccoli di solito danno risultati che si discostano dal contesto. Afferrare frasi, modi di dire o combinazioni linguistiche di parole complesse è un compito impegnativo. In altre parole, la retro-traduzione ha un significato diverso rispetto alla frase della fonte naturale.

Per affrontare questo problema, i ricercatori adottano l’idea che tradurre le traduzioni indietro è più facile che tradurre frasi di origine presenti in natura.

Il modello di preprocessing automatizzato (APP) si basa su questa osservazione secondo cui le traduzioni di riferimenti umani quando tradotte in lingua originale sono una ricca fonte di semplificazioni (ad esempio, “saltare in” è semplificato per “prendere parte”).

Questa osservazione, ha affermato il team Netflix, porta a due corollari immediati:

traducendo indietro la verità fondamentale le traduzioni umane nella lingua di partenza danno come risultato una versione semplificata della fonte originale, e

una funzione per mappare le frasi sorgente alla sua versione semplificata può essere appresa allenando un modello da sequenza a sequenza (S2S).

La valutazione del modello è stata effettuata sui set di dati GIGS, Wikilarge e Open Sottotitoli. Il set di dati FIGS proviene da sottotitoli che appaiono su 12.301 programmi TV e film da un fornitore di video on demand su abbonamento.

Per la formazione del modello di semplificazione APP, i ricercatori hanno utilizzato l’architettura Transformer attraverso la libreria tensor2tensor. Tutti gli esperimenti sono stati condotti utilizzando l’architettura di base del trasformatore con 6 blocchi nell’encoder e nel decodificatore e vengono eseguiti utilizzando 4 GPU NVIDIA V100.

Anche se questo lavoro si concentra principalmente sulla semplificazione dei sottotitoli in inglese, il modello è universale e può essere utilizzato per altre lingue.

“Il nostro lavoro unisce due importanti sotto-campi di traduzione automatica e semplificazione delle frasi e apre la strada per future ricerche in entrambi questi campi”, hanno scritto i ricercatori.

Secondo Netflix, gli errori nei sottotitoli potrebbero non essere così critici ma sono sottili. Queste esperienze si sommano e potrebbero influire sul coinvolgimento degli utenti. A volte Netflix rifiuta un sottotitolo anche se i sottotitoli sono grammaticalmente corretti ma non riescono a ottenere correttamente le frasi e i colloquiali semplici.

Tradurre espressioni multiword e frasi non composizionali è un compito complicato e semplificare queste espressioni prima di tradurre aiuto. Questo lavoro unisce la traduzione automatica e la semplificazione delle frasi; due importanti sottocampi della PNL e i ricercatori ritengono che ciò porterà a ulteriori ricerche.